Подключение к DriversCloud Создать аккаунт на DriversCloud.com Изменение пароля на DriversCloud.com Миграция счетов

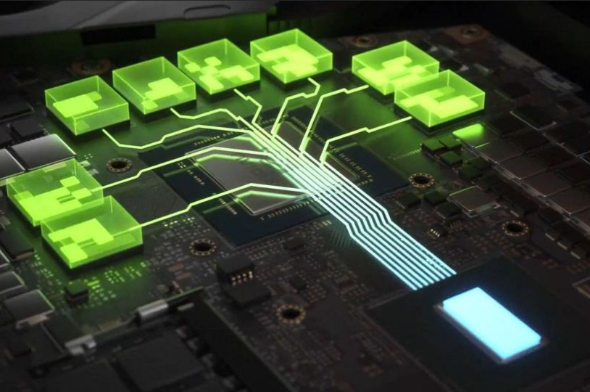

NVIDIA переосмысливает сжатие текстур

Новая техника сжатия позволяет использовать меньше видеопамяти, наслаждаясь большей детализацией.

В то время как NVIDIA продолжает совершенствовать свои графические решения, выпуская новые поколения видеопроцессоров каждые несколько лет, она также улучшает программную среду для своих продуктов. Например, почти все геймеры теперь знакомы с Deep Learning Super Sampling или DLSS, техникой, которая уменьшает вычисления, возлагаемые на видеокарту, прося ее рассчитать сцену в более низком разрешении изображения, чем то, которое будет отображаться на экране: искусственный интеллект затем заботится о подгонке изображения к нужному размеру без того, чтобы рендеринг сильно отличался от нативного режима.

На прошлой неделе длинная техническая статья, опубликованная на техническом сайте NVIDIA - research, стала поводом для представления техники, которая еще находится в стадии разработки, но уже очень перспективна. Идея здесь заключается в том, чтобы вернуться к сжатию текстур. В настоящее время такое сжатие уже очень эффективно, но оно все еще требует слишком много места в видеопамяти, при этом значительно снижая уровень детализации по сравнению с изначально созданной текстурой. Поэтому команда под руководством Картика Вайдьянатана представила свою первую работу по так называемому "нейронному сжатию ". Вайдьянатан объясняет, что цель его команды - добиться значительного увеличения детализации текстуры и в то же время уменьшить объем занимаемого места в видеопамяти. То, что может показаться непреодолимой задачей, на самом деле успешно решается, так как NVIDIA уже заявляет о четырехкратном увеличении четкости текстур при сокращении объема видеопамяти на 30%.

В таком виде это кажется почти волшебством, но Картик Вайдьянатан и его команда проведут более подробную презентацию этого "нейронного сжатия " 6 августа. Пока же, по его словам, цель заключалась в том, чтобы пойти значительно дальше используемых в настоящее время методов (AVIF и JPEG XL). Так, инженеры хотели сохранить разрешение 4 096 x 4 096 точек - такое же, как у родной текстуры - в то время как предыдущие методы уменьшали его до 1 024 x 1 204 точек с, в конечном счете, огромной потерей деталей. Не вдаваясь в технические подробности, Картик Вайдьянатан просто отмечает, что по сравнению с более распространенными алгоритмами блочного сжатия, здесь нет необходимости в специализированном оборудовании: нейронное сжатие NVIDIA использует метод матричного умножения, который ускоряется всеми современными GPU. Это очень перспективное решение, позволяющее избежать дальнейшего увеличения объема видеопамяти в будущих поколениях видеокарт.